Aya Vision: Как опенсорс-модель для 101 языка бросает вызов Google и OpenAI

Cohere For AI представила Aya Vision — открытую модель, понимающую изображения на 101 языке. Анализ, как она конкурирует с Gemini Pro и CLIP.

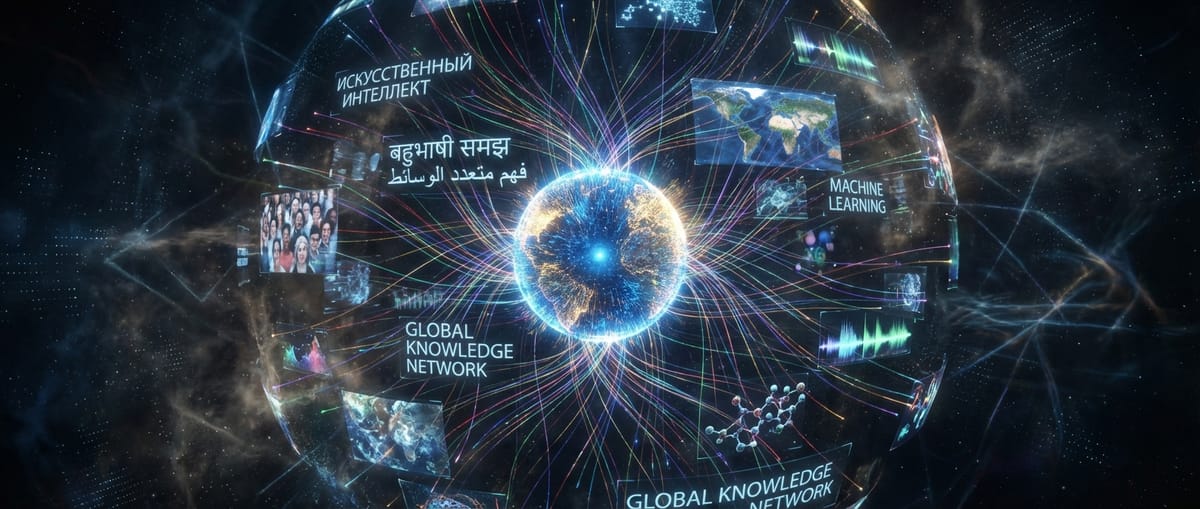

Пока технологические гиганты вроде Google и OpenAI продолжают свою стероидную гонку, наращивая триллионы параметров и соревнуясь в том, кто лучше нарисует фотореалистичного кота в космосе, в опенсорс-сообществе происходит куда более интересная и, возможно, важная работа. Речь о проекте Aya Vision от некоммерческой лаборатории Cohere For AI. Они выпустили открытую мультимодальную модель, которая понимает изображения и текст на 101 языке. И это не просто красивая цифра для пресс-релиза, а прямой вызов всей философии современного AI, зацикленного на английском языке.

Давайте к деталям. В основе Aya Vision лежит комбинация двух ключевых компонентов: уже известной модели для распознавания образов SigLIP и совершенно нового многоязычного текстового энкодера Aya-23. Последний — это 8-миллиардная модель, специально обученная на 23 языках. Весь этот «бутерброд» не только выложен в открытый доступ под либеральной лицензией Apache 2.0, но и сопровождается датасетом Aya-V, на котором он обучался. Это значит, что любой исследователь или стартап из условной Индонезии или Нигерии может взять эту технологию и адаптировать под свои нужды, не платя дань корпорациям из Пало-Альто. Деньги в проект вкладывает сама Cohere, Google и еще ряд филантропов, что делает эту инициативу еще более любопытной.

Самое интересное начинается, когда мы смотрим на бенчмарки. На бумаге 8 миллиардов параметров — это игрушки по сравнению с гигантами вроде Gemini. Но дьявол, как всегда, в деталях. В задачах, где нужно сопоставить изображение и его описание на языках, отличных от английского, Aya Vision демонстрирует поразительные результаты. Она не просто обходит другие открытые модели, но и умудряется превзойти в некоторых тестах проприетарные API от Google (Gemini Pro) и OpenAI (CLIP). Это как если бы хорошо собранный крафтовый автомобиль обогнал на извилистой трассе неуклюжий, но мощный карьерный самосвал. Модель доказывает, что грубая сила и количество параметров — не единственный путь к успеху, а фокус на качестве и разнообразии данных может дать асимметричное преимущество.

Все это происходит на фоне большой идеологической битвы. Последние пару лет мы наблюдаем, как «открытый» AI (OpenAI) становится все более закрытым, а Google пытается догнать конкурента, полагаясь на свою колоссальную инфраструктуру. Их модели, безусловно, мощны, но они несут в себе врожденный недостаток — «цифровой колониализм». Они прекрасно понимают мемы на английском, но могут спасовать перед простой культурной реалией, описанной на хинди или суахили. Проекты, подобные Aya, — это попытка децентрализовать будущее искусственного интеллекта. Они создают инструменты, которые позволяют миллиардам людей, не говорящим по-английски, стать не просто потребителями, а создателями новых технологий.

Именно в этом контексте шаг Cohere For AI выглядит особенно дальновидным. Вместо того чтобы ввязываться в лобовую атаку на OpenAI и Google на их поле, они играют вдолгую. Создавая и поддерживая сильное опенсорс-комьюнити, они не только получают доступ к глобальному пулу талантов, но и формируют стандарт для действительно многоязычного AI. Это умный ход, который одновременно решает реальную мировую проблему и укрепляет позиции Cohere как серьезного игрока, мыслящего не только квартальными отчетами.

Наш вердикт: Это, безусловно, не «убийца Gemini» в глобальном смысле. Aya Vision не будет генерировать видео по текстовому запросу или писать за вас диссертацию. Но это и не ее задача. Это мощный технологический и идеологический стейтмент. Проект доказывает, что эра англоцентричного AI подходит к концу, и будущее за моделями, которые уважают лингвистическое разнообразие нашего мира. Для сотен миллионов людей это куда более важный прорыв, чем очередное увеличение производительности в тестах на английском языке. Это не просто еще одна модель, это декларация о намерениях, и индустрии придется с ней считаться.